Мультиколлинеарность – это линейная зависимость между двумя или несколькими факторными переменными в уравнении множественной регрессии. Если такая зависимость является функциональной, то говорят о полной мультиколлинеарности . Если же она является корреляционной, то имеет место частичная мультиколлинеарность . Если полная мультиколлинеарность является скорее теоретической абстракцией (она проявляется, в частности, если фиктивную переменнную, имеющую k уровней качества, заменить на k дихотомических переменных), то частичная мультиколлинеарность весьма реальна и присутствует практически всегда. Речь может идти лишь о степени ее выраженности. Например, если в состав объясняющих переменных входят располагаемый доход и потребление, то обе эти переменные, конечно, будут сильно коррелированными.

Отсутствие мультиколлинеарности является одной из желательных предпосылок классической линейной множественной модели. Это связано со следующими соображениями:

1) В случае полной мультиколинеарности вообще невозможно построить оценки параметров линейной множественной регрессии с помощью МНК.

2) В случае частичной мультиколлинеарности оценки параметров регрессии могут быть ненадежными и, кроме того, затруднено определение

изолированного вклада факторов в результативный показатель.

Главной причиной возникновения мультиколлинеарности является наличие в изучаемом объекте процессов, которые одновременно влияют на некоторые входные переменные, но не учтены в модели. Это может быть результатом некачественного исследования предметной области или сложности взаимосвязей параметров изучаемого объекта.

Подозрением наличия мультиколлинеарности служат:

– большое количество незначимых факторов в модели;

– большие стандартные ошибки параметров регрессии;

– неустойчивость оценок (небольшое изменение исходных данных приводит к их существенному изменению).

Один из подходов для определения наличия или отсутствия мультиколлинеарности заключается в анализе корреляционной матрицы

между объясняющими переменными и выявлении пар факторов, имеющих высокие коэффициенты парной корреляции (обычно больше 0,7). Если такие факторы существуют, то говорят о явной коллинеарности между ними.

Однако парные коэффициенты корреляции, рассматриваемые индивидуально, не могут оценить совокупное взаимодействие нескольких факторов (а не только двух).

Поэтому для оценки наличия мультиколлинеарности в модели используется определитель матрицы парных коэффициентов корреляции между факторами (определитель матрицы межфакторной корреляции )

Чем ближе определитель матрицы межфакторной корреляции к 0, тем сильнее мультиколлинеарность, и наоборот, чем ближе определитель к 1, тем меньше мультиколлинеарность.

Статистическая значимость мультиколлинеарности факторов определяется проверкой нулевой гипотезы при альтернативной гипотезе . Для проверки нулевой гипотезы используется распределение Пирсона с степенями свободы. Наблюдаемое значение статистики находится по формуле , где n – число наблюдений, m – число факторов. Для заданного уровня значимости по таблице критических точек распределения Пирсона определяется критическое значение . Если , то гипотеза отклоняется и считается, что в модели присутствует мультиколлинеарность факторов.

Выделить факторы, влияющие на мультиколлинеарность, позволяет также анализ коэффициентов множественной детерминации, вычисленных при условии, что каждый из факторов рассматривается в качестве зависимой переменной от других факторов: , , …, . Чем ближе они к 1, тем сильнее мультиколлинеарность факторов. Значит, в уравнении следует оставлять факторы с минимальной величиной коэффициента множественной детерминации.

Что касается полной мультиколлинеарности, то с ней следует вести самую решительную борьбу: сразу же удалять из регрессионного уравнения переменные, которые являются линейными комбинациями другихпеременных.

Частичная мультиколлинеарность не является таким уж серьезным злом, чтобы ее выявлять и устранять. Все зависит от целей исследования. Если основная задача моделирования – только прогнозирование значений зависимой переменной, то при достаточно большом коэффициенте детерминации () присутствие мультиколлинеарности не сказывается на прогнозных качествах модели. Если же целью моделирования является и определение вклада каждого фактора в изменение зависимой переменной, то наличие мультиколлинеарности является серьезной проблемой.

Простейшим методом устранения мультиколлинеарности является исключение из модели одной или ряда коррелированных переменных.

Поскольку мультиколлинеарность напрямую зависит от выборки, то, возможно, при другой выборке мультиколлинеарности не будет вообще либо она не будет настолько серьезной. Поэтому для уменьшения мультиколлинеарности в ряде случаев достаточно увеличить объем выборки.

Иногда проблема мультиколлинеарности может быть решена путем изменения спецификации модели: либо изменяется форма модели, либо добавляются факторы, не учтенные в первоначальной модели, но существенно влияющие на зависимую переменную.

В ряде случаев минимизировать либо совсем устранить мультиколлинеарность можно с помощью преобразования факторных переменных. При этом наиболее распространены следующие преобразования:

1. Линейная комбинация мультиколлинеарных переменных (например, ).

2. Замена мультиколлинеарной переменной ее приращением .

3. Деление одной коллинеарной переменной на другую.

Предположим, что мы рассматриваем регрессионное уравнение и данные для его оценки содержат наблюдения для разных по качеству объектов: для мужчин и женщин, для белых и черных. вопрос, который нас может здесь заинтересовать, следующий – верно ли, что рассматриваемая модель совпадает для двух выборок, относящихся к объектам разного качества? Ответить на этот вопрос можно при помощи теста Чоу.

Рассмотрим модели:

, i =1,…,N (1);

, i =N +1,…,N +M (2).

В первой выборке N наблюдений, во второй – М наблюдений. Пример: Y – заработная плата, объясняющие переменные – возраст, стаж, уровень образования. Следует ли из имеющихся данных, что модель зависимости заработной платы от объясняющих переменных, стоящих в правой части одинакова для мужчин и женщин?

Для проверки этой гипотезы можно воспользоваться общей схемой проверки гипотез при помощи сравнения регрессии с ограничениями и регрессии без ограничений. Регрессией без ограничений здесь является объединение регрессий (1) и (2), т. е. ESS UR = ESS 1 + ESS 2 , число степеней свободы – N + M - 2k . Регрессией с ограничениями (т. е. регрессией в предположении, что выполнена нулевая гипотеза) будет являться регрессия для всего имеющегося набора наблюдений:

, i = 1,…, N +M (3).

Оценивая (3), получаем ESS R . Для проверки нулевой гипотезы используем следующую статистику:

Которая в случае справедливости нулевой гипотезы имеет распределение Фишера с числом степеней свободы числителя k и знаменателя N + M - 2k .

Если нулевая гипотеза справедлива, мы можем объединить имеющиеся выборки в одну и оценивать модель для N + M наблюдений. Если же нулевую гипотезу отвергаем, то мы не можем слить две выборки в одну, и нам придется оценивать эти две модели по отдельности.

Изучение общей линейной модели, рассмотренной нами ранее, весьма существенно, как мы видели, опирается на статистический аппарат. Однако, как и во всех приложениях мат. статистики, сила метода зависит от предположений, лежащих в его основе и необходимых для его применения. Некоторое время мы будем рассматривать ситуации, когда одна или более гипотез, лежащих в основе линейной модели, нарушается. Мы рассмотрим альтернативные методы оценивания в этих случаях. Мы увидим, что роль одних гипотез более существенна по сравнению с ролью других. Нам надо посмотреть, к каким последствиям может привести нарушения тех или иных условий (предположений), уметь проверить, удовлетворяются они или нет и знать, какие статистические методы можно и целесообразно применять, когда не подходит классический метод наименьших квадратов.

1. Связь между переменными линейная и выражается уравнением - ошибки спецификации модели (невключение в уравнение существенных объясняющих переменных, включение в уравнение лишних переменных, неправильный выбор формы зависимости между переменными);

2. X 1 ,…,X k – детерминированные переменные – стохастические регрессоры, линейно независимые – полная мультиколлинеарность;

4. - гетероскедастичность;

5. при i ¹ k – автокорреляция ошибок

Прежде чем приступать к разговору, рассмотрим следующие понятия: парный коэффициент корреляции и частный коэффициент корреляции.

Предположим, что мы исследуем влияние одной переменной на другую переменную (Y и X ). Для того чтобы понять, насколько эти переменные связаны между собой, мы вычисляем парный коэффициент корреляции по следующей формуле:

Если мы получили значение коэффициента корреляции близкое к 1, мы делаем вывод о том, что переменные достаточно сильно связаны между собой.

Однако, если коэффициент корреляции между двумя исследуемыми переменными близок к 1, на самом деле они могут и не быть зависимыми. Пример с душевнобольными и радиоприемниками – пример так называемой «ложной корреляции». Высокое значение коэффициента корреляции может быть обусловлено и существованием третьей переменной, которая оказывает сильное влияние на первые две переменные, что и служит причиной их высокой коррелируемости. Поэтому возникает задача расчета «чистой» корреляции между переменными X и Y , т. е. корреляции, в которой исключено влияние (линейное) других переменных. Для этого и вводят понятие коэффициента частной корреляции.

Итак, мы хотим определить коэффициент частной корреляции между переменными X и Y , исключив линейное влияние переменной Z . Для его определения используется следующая процедура:

1. Оцениваем регрессию ,

2. Получаем остатки ,

3. Оцениваем регрессию ,

4. Получаем остатки ,

5. - выборочный коэффициент частной корреляции, измеряет степень связи между переменными X и Y , очищенную от влияния переменной Z .

Прямые вычисления:

Свойство:

Процедура построения коэффициента частной корреляции обобщается на случай, если мы хотим избавиться от влияния двух и более переменных.

1. Совершенная мультиколлинеарность.

Одно из требований Гаусса-Маркова говорит нам о том, чтобы объясняющие переменные не были связаны никаким точным соотношением. Если такое соотношение между переменными существует, мы говорим о том, что в модели присутствует совершенная мультиколлинеарность. Пример. Рассмотрим модель со средней оценкой на экзамене, состоящую из трех объясняющих переменных: I - доход родителей, D - среднее число часов, затраченных на обучение в день, W - среднее число часов, затраченных на обучение в неделю. Очевидно, что W =7D . И это соотношение будет выполняться для каждого студента, который попадет в нашу выборку. Случай полной мультиколлинеарности отследить легко, поскольку в этом случае невозможно построить оценки по методу наименьших квадратов.

2. Частичная мультиколлинеарность или просто мультиколлинеарность.

Гораздо чаще встречается ситуация, когда между объясняющими переменными точной линейной зависимости не существует, но между ними существует тесная корреляционная зависимость – этот случай носит название реальной или частичной мультиколлинеарности (просто мультиколлинеарность) – существование тесных статистических связей между переменными. Надо сказать, что вопрос мультиколлинеарности – это вопрос скорее степени выраженности явления, а не его вида. Оценка любой регрессии будет страдать от нее в том или ином виде, если только все независимые переменные не окажутся абсолютно некоррелированными. Рассмотрение данной проблемы начинается только тогда, когда это начинает серьезно влиять на результаты оценки регрессии (наличие статистических связей между регрессорами вовсе не обязательно дает неудовлетворительные оценки). Итак, мультиколлинеарность – это проблема, когда тесная корреляционная зависимость между регрессорами ведет к получению ненадежных оценок регрессии.

Последствия мультиколлинеарности:

Формально, поскольку (X "X ) – невырожденная, то мы можем построить МНК-оценки коэффициентов регрессии. Однако вспомним, как выражаются теоретические дисперсии оценок коэффициентов регрессии: , где a ii - i -й диагональный элемент матрицы . Поскольку матрица (X"X) близка к вырожденной и det(X "X ) » 0, то

1) на главной диагонали обратной матрицы стоят очень большие числа, поскольку элементы обратной матрицы обратно пропорциональны det(X "X ). Следовательно, теоретическая дисперсия i -го коэффициента достаточно большая и оценка дисперсии так же большая, следовательно, t - статистики небольшие, что может привести к статистической незначимости i -го коэффициента. Т. е. переменная оказывает значимое влияние на объясняемую переменную, а мы делаем вывод о ее незначимости.

2) Поскольку оценки и зависят от (X "X ) -1 , элементы которой обратно пропорциональны det(X "X ), то если мы добавим или уберем одно-два наблюдения, добавив или убрав, таким образом, одну-две строки к матрице X "X , то значения и могут измениться существенным образом, вплоть до смены знака – неустойчивость результатов оценивания.

3) Трудность интерпретации уравнения регрессии. Допустим, у нас в уравнении есть две переменные, которые связаны между собой между собой: X 1 и X 2 . Коэффициент регрессии при X 1 интерпретируется как мера изменения Y за счет изменения X 1 при прочих равных условиях, т.е. значения всех других переменных остаются прежними. Однако, поскольку переменные Х 1 и Х 2 связаны, то изменения в переменной Х 1 повлекут за собой предсказуемые изменения в переменной Х 2 и значение Х 2 не останется прежним.

Пример: , где Х 1 – общая площадь, Х 2 – жилая площадь. Мы говорим: "Если жилая площадь увеличиться на 1 кв. м., то при прочих равных условиях цена квартиры увеличиться на долл". Однако в этом случае и жилая площадь увеличится на 1 кв. м. и прирост цены будет . Разграничить влияние на переменную Y каждой переменной в отдельности уже не представляется возможным. Выход в данной ситуации с ценой на квартиру -–включить в модель не общую площадь, а так называемую "добавочную" или "дополнительную" площадь.

Признаки мультиколлинеарности.

Точных критериев для определения наличия (отсутствия) мультиколлинеарности не существует. Однако есть эвристические рекомендации по ее выявлению:

1) Анализируют матрицу парных коэффициентов корреляции между регрессорами и если значение коэффициента корреляции близко к 1, то это считается признаком мультиколлинеарности.

2) Анализ матрицы корреляции – лишь поверхностное суждение о наличии (отсутствии) мультиколлинеарности. Более внимательное изучение этого вопроса достигается при помощи расчета коэффициентов частной корреляции или расчетов коэффициентов детерминации каждой из объясняющих переменных по всем другим объясняющим переменным в регрессии .

4) (Х ’X ) – симметричная положительно определенная матрица, следовательно, все ее собственные числа неотрицательны. Если определитель матрицы (Х ’X ) равен нулю, то минимальное собственное число так же ноль и непрерывность сохраняется. Следовательно, по значению манимального собственного числа можно судить и о близости к нулю определителя матрицы (Х ’X ). Кроме этого свойства минимальное собственное число важно еще и потому, что стандартная ошибка коэффициента обратно пропорциональна .

5) О наличии мультиколлинеарности можно судить по внешним признакам, являющимся следствиями мультиколлинеарности:

a) некоторые из оценок имеют неправильные с точки зрения экономической теории знаки или неоправданно большие значения;

b) небольшое изменение исходных экономических данных приводит к существенному изменению оценок коэффициентов модели;

c) большинство t -статистик коэффициентов незначимо отличаются от нуля, в то же время модель в целом является значимой, о чем говорит высокое значение F -статистики.

Как избавится от мультиколлинеарности, как ее устранить:

1) Использование факторного анализа. Переход от исходного набора регрессоров, среди которых есть статистически зависимые, к новым регрессорам Z 1 ,…,Z m при помощи метода главных компонент – вместо исходных переменных вместо исходных переменных рассматриваем некоторые их линейные комбинации, корреляция между которыми мала или отсутствует вообще. Задача здесь – дать содержательную интерпретацию новым переменным Z . Если не удалось – возвращаемся к исходным переменным, используя обратные преобразования. Полученные оценки будут, правда, смещенными, но будут иметь меньшую дисперсию.

2) Среди всех имеющихся переменных отобрать наиболее существенно влияющих на объясняемую переменную факторов. Процедуры отбора будут рассмотрены ниже.

3) Переход к смещенным методам оценивания.

Когда мы сталкиваемся с проблемой мультиколлинеарности, то у неискушенного исследователя поначалу возникает желание просто исключить лишние регрессоры, которые, возможно, служат ее причиной. Однако не всегда ясно, какие именно переменные являются лишними в указанном смысле. Кроме того, как будет показано ниже, отбрасывание так называемых существенно влияющих переменных приводит к смещенности МНК-оценок.

Отметим, что в ряде случаев мультиколлинеарность не является таким уж серьезным «злом», чтобы прилагать существенные усилия по ее выявлению и устранению. В основном, все зависит от целей исследования.

Если основная задача модели - прогноз будущих значений зависимой переменной, то при достаточно большом коэффициенте детерминации R2(gt; 0,9) наличие мультиколлинеарности обычно не сказывается на прогнозных качествах модели (если в будущем между коррелированными переменными будут сохраняться те же отношения, что и ранее).

Если необходимо определить степень влияния каждой из объясняющих переменных на зависимую переменную, то мультиколлинеарность, приводящая к увеличению стандартных ошибок, скорее всего, исказит истинные зависимости между переменными. В этой ситуации мультиколлинеарность является серьезной проблемой.

Единого метода устранения мультиколлинеарности, годного в любом случае, не существует. Это связано с тем, что причины и последствия мультиколлинеарности неоднозначны и во многом зависят от результатов выборки.

Исключение переменной(ых) из модели

Простейшим методом устранения мультиколлинеарности является исключение из модели одной или ряда коррелированных переменных. При применении данного метода необходима определенная осмотрительность. В данной ситуации возможны ошибки спецификации, поэтому в прикладных эконометрических моделях желательно не исключать объясняющие переменные до тех пор, пока мультиколлинеарность не станет серьезной проблемой.

Получение дополнительных данных или новой выборки

Поскольку мультиколлинеарность напрямую зависит от выборки, то, возможно, при другой выборке мультиколлинеарности не будет либо она не будет столь серьезной. Иногда для уменьшения мультиколлинеарности достаточно увеличить объем выборки. Например, при использовании ежегодных данных можно перейти к поквартальным данным. Увеличение количества данных сокращает дисперсии коэффициентов регрессии и тем самым увеличивает их статистическую значимость. Однако получение новой выборки или расширение старой не всегда возможно или связано с серьезными издержками. Кроме того, такой подход может усилить автокорреляцию. Эти проблемы ограничивают возможность использования данного метода.

Изменение спецификации модели

В ряде случаев проблема мультиколлинеарности может быть решена путем изменения спецификации модели: либо изменяется форма модели, либо добавляются объясняющие переменные, не учтенные в первоначальной модели, но существенно влияющие на зависимую переменную. Если данный метод имеет основания, то его использование уменьшает сумму квадратов отклонений, тем самым сокращая стандартную ошибку регрессии. Это приводит к уменьшению стандартных ошибок коэффициентов.

Использование предварительной информации о некоторых параметрах

Иногда при построении модели множественной регрессии можно воспользоваться предварительной информацией, в частности известными значениями некоторых коэффициентов регрессии.

Вполне вероятно, что значения коэффициентов, рассчитанные для каких-либо предварительных (обычно более простых) моделей либо для аналогичной модели по ранее полученной выборке, могут быть использованы для разрабатываемой в данный момент модели.

Отбор наиболее существенных объясняющих переменных. Процедура последовательного присоединения элементов

Переход к меньшему числу объясняющих переменных может уменьшить дублирование информации, доставляемой сильно взаимозависимыми признаками. Именно с этим мы сталкиваемся в случае мультиколлинеарности объясняющих переменных.

Пусть

Множественный коэффициент

корреляции между зависимой переменной Y и набором объясняющих переменных X 1,X 2,...,Xm. Он определяется как обычный парный коэффициент корреляции между Y и линейной функцией

регрессии Y = b0 + KX1 + b2X2+... + bmXm. Пусть amp; = R-1 - матрица, обратная к матрице R:

Тогда квадрат коэффициента Ry.X = Rr(xi,x2,..,x) может быть вычислен по формуле:

Подправленная на несмещенность оценка R*2.X коэффициента детерминации R2y.X имеет вид:

(Если поформуле (6.7) получают отрицательное число, то полагают

Нижняя доверительная граница для

определяется

по формуле:

На практике, при решении вопроса о том, какие объясняющие переменные следует включать в модель, часто используют процедуру последовательного присоединения элементов.

(j = 1, 2,..., m) . При этом

совпадает с квадратом обычного

парного коэффициента корреляции

Пусть

тогда наиболее информативной будет переменная xp. Затем рассчитывают подправленный на несмещенность коэффициент

(при m = 1) и его нижнюю доверительную границу R2min (1) .

более информативной будет пара jxp,xq). Затемрассчитывают подправленный на несмещенность коэффициент(при m = 2)

и его нижнюю доверительную границу R2min (2) .

Процедуру продолжают до тех пор, когда на шаге (к +1) выполнится условие:

Тогда в модель включают наиболее информативные переменные, полученные на первых к шагах. Отметим, что в расчетах используют формулы (6.7) и (6.8), в которых вместо т берут соответствующее значение номера шага к.

На самом деле этот метод не гарантирует, что мы избавимся от мультиколлинеарности.

Используют и другие методы устранения мультиколлинеарности.

Пример 6.1. Имеются следующие условные данные (табл. 6.1):

Таблица 6.1

Данные для метода последовательного включения

| Х1 | Х2 | Х3 | У |

| 1 | 1,5 | 0,7 | 12 |

| 2 | 2,5 | 1,2 | 20 |

| 3 | 1 | 1,4 | 15 |

| 4 | 5,5 | 1,9 | 41 |

| 5 | 3 | 2,5 | 33 |

| 6 | 3 | 3,1 | 35 |

| 7 | 2,8 | 3,5 | 38 |

| 8 | 0,5 | 4 | 28 |

| 9 | 4 | 3,8 | 47 |

| 10 | 2 | 5,3 | 40 |

Рассмотрим влияние на зависимую переменную каждой из объясняющих переменных в отдельности. Вычисляя парные коэффициенты корреляции, получим, что наибольшее значение имеет коэффициент

Тогда:

Рассмотрим влияние на зависимую переменную пар переменных (x1, x2) и (x1, x3). Сначала рассмотрим влияние пары переменных (x1, x2).

icuvum uvjpcuuivi, ыхсдул рсьимслдсіцшім мсіида ііи^ісдиьсіїсльпи-

го присоединения переменных, в уравнение следует включить две объясняющие переменные. Следовательно, теоретическое уравнение примет вид:

Гребневой метод

Рассмотрим «гребневой метод» («ридж-регрессия») устранения мультиколлинеарности. Метод был предложен А. Э. Хоэрлом в 1962 г. и применяется, когда матрица (xtX) близка к вырожденной. К диагональным элементам матрицы (xtX) добавляют некоторое небольшое число (от 0,1 до 0,4). При этом получают смещенные оценки параметров уравнения. Но стандартные ошибки таких оценок в случае мультиколлинеарности ниже ошибок даваемых обычным методом наименьших квадратов.

Пример 6.2. Исходные данные представлены « табл6 2 Коэффициент корреляции объясняющих переменных

что

свидетельствует о сильной мультиколлинеарности.

Таблица 6.2

Данные для исследования мультиколлинеарности гребневым методом

| x1 | x2 | У |

| 1 | 1,4 | 7 |

| 2 | 3,1 | 12 |

Тогда получим уравнение у = 2,63 +1,37x1 + 1,95x2. Диагональные элементы обратной матрицы значительно снизятся и будут равны z00 = 0,45264, z11 = 1,57796, z00 = 0,70842, что приводит к снижению стандартных ошибок коэффициентов.

Резюме

Среди основных последствий, к которым может привести мультиколлинеарность, можно выделить следующие:

- при проверке основной гипотезы о незначимости коэффициентов множественной регрессии с помощью t-критерия в большинстве случаев она принимается, однако само уравнение регрессии при проверке с помощью A-критерия оказывается значимым, что говорит о завышенной величине коэффициента множественной корреляции;

- полученные оценки коэффициентов уравнения множественной регрессии в основном неоправданно завышены или имеют неправильные знаки;

- добавление или исключение из исходных данных одного- двух наблюдений оказывает сильное влияние на оценки коэффициентов модели;

- наличие мультиколлинеарности в модели множественной регрессии может сделать ее непригодной для дальнейшего применения (например, для построения прогнозов).

- Что такое мультиколлинеарность?

- Какие показатели свидетельствуют о наличии мультиколлинеарности?

- Чему равен определитель матрицы XTX в случае совершенной мультиколлинеарности?

- Что можно сказать о смысле коэффициентов при объясняющих переменных в случае мультиколлинеарности?

- Какое преобразование производят в гребневом методе, к чему оно приводит?

- Каков порядок действий в методе последовательного увеличения числа объясняющих переменных?

- Что показывает коэффициент корреляции?

- Что показывает частный коэффициент корреляции?

Министерство образования и науки Российской Федерации

Федеральное государственное бюджетное образовательное учреждение

высшего образования

ТВЕРСКОЙ ГОСУДАРСТВЕННЫЙ ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ

Кафедра «Бухгалтерский учет и финансы»

КУРСОВОЙ ПРОЕКТ

по дисциплине «Эконометрика»

“Исследование мультиколлинеарности в эконометрических моделях: исключение переменной (ых) из модели”

Руководитель работы:

канд. тех. наук, доцент

Коновалова

Исполнитель:

студент группы ЭК-1315 ЭПО

Тверь, 2015

Введение…………………………………………………………………………...3

1.Аналитическая часть……………………………………………………………4

1.1. Обобщенные признаки мультиколлинеарности в эконометрических моделях…………………………………………………………………………….4

1.2. Основные способы устранения мультиколлинеарности в эконометрических моделях…………..…………………………………………..7

2.Проектная часть………………………………………………………………..11

2.1. Информационно-методическое обеспечение эконометрического исследования………………………………………………………………….11

2.2. Пример эконометрического исследования…………………………….17

Заключение ……………………………………………………………………....30

Список использованных источников…………………………………………...31

Введение

Актуальность темы работы “Исследование мультиколлинеарности в эконометрических моделях: исключение переменной (ых) из модели” обусловлена тем, что в наше время данная проблема часто встречается в прикладных эконометрических моделях.

Предмет исследования - проблема мультиколлинеарности. Объектом исследования выступают эконометрические модели.

Основная цель работы - разработка проектных решений по информационно-методическому обеспечению эконометрического исследования.

Для достижения цели поставлены и решены следующие основные задачи исследования:

- Обобщение признаков мультиколлинеарности в эконометрических моделях.

- Выявление основных способов устранения мультиколлинеарности.

3.Разработка информационно-методического обеспечения эконометрического исследования.

- Аналитическая часть

1.1. Обобщенные признаки мультиколлинеарности в эконометрических моделях

Мультиколлинеарность — в эконометрике (регрессионный анализ) — наличие линейной зависимости между объясняющими переменными (факторами) регрессионной модели. При этом различают полную коллинеарность , которая означает наличие функциональной (тождественной) линейной зависимости, и частичную или просто мультиколлинеарность — наличие сильной корреляции между факторами .

Полная коллинеарность приводит к неопределенности параметров в линейной регрессиионной модели независимо от методов оценки. Рассмотрим это на примере следующей линейной модели:

Пусть факторы этой модели тождественно связаны следующим образом: . Тогда рассмотрим исходную линейную модель, в которой к первому коэффициенту добавим произвольное число a , а из двух других коэффициентов это же число вычтем. Тогда имеем (без случайной ошибки):

Таким образом, несмотря на относительно произвольное изменение коэффициентов модели получается та же модель. Такая модель принципиально неидентифицируема. Неопределенность существует уже в самой модели. Если рассмотреть 3-мерное пространство коэффициентов, то в этом пространстве вектор истинных коэффициентов в данном случае не единственный, а представляет собой целую прямую линию. Любая точка этой прямой — истинный вектор коэффициентов .

Если полная коллинеарность приводит к неопределенности значений параметров, то частичная мультиколлинеарность приводит к неустойчивости их оценок . Неустойчивость выражается в увеличении статистической неопределенности — дисперсии оценок. Это означает, что конкретные результаты оценки могут сильно различаться для разных выборок несмотря на то, что выборки однородны.

Как известно ковариационная матрица оценок параметров множественной регрессии методом наименьших квадратов равна. Тем самым чем «меньше» ковариационная матрица (ее определитель), тем «больше» ковариационная матрица оценок параметров, и, в частности, больше диагональные элементы этой матрицы, то есть дисперсии оценок параметров. Для большей наглядности рассмотрим на примере двухфакторной модели:

Тогда дисперсия оценки параметра, например, при первом факторе равна:

где — выборочный коэффициент корреляции между факторами.

Здесь наглядно видно, что чем больше по модулю корреляция между факторами, тем больше дисперсия оценок параметров. При (полная коллинеарность) дисперсия стремится к бесконечности, что соответствует сказанному ранее.

Таким образом, оценки параметров получаются неточными, а значит сложно будет дать интерпретацию влияния тех или иных факторов на объясняемую переменную. При этом на качество модели в целом мультиколлинеарность не сказывается — она может признаваться статистически значимой, даже тогда, когда все коэффициенты незначимы (это один из признаков мультиколлинеарности).

В линейных моделях коэффициенты корреляции между параметрами могут быть положительными и отрицательными. В первом случае увеличение одного параметра сопровождается увеличением и другого параметра. Во втором случае при повышении одного параметра происходит снижение другого.

Исходя из этого, можно установить допустимую и недопустимую мультиколлинеарность. Недопустимая мультиколлинеарность будет тогда, когда между факторами 1 и 2 существует значительная положительная корреляция и при этом влияние каждого фактора на корреляционную связь с функцией у однонаправленное, то есть увеличение обоих факторов 1 и 2 ведёт к увеличению или снижению функции у . Другими словами, оба фактора действуют на функцию у одинаково, и значительная положительная корреляции между ними может позволить исключить один из них.

Допустимая мультиколлинеарность такова, при которой факторы действуют на функцию у неодинаково. Здесь возможны два случая:

а) при значительной положительной корреляции между факторами влияние каждого фактора на корреляционную связь с функцией у разнонаправленное, т.е. увеличение одного фактора ведёт к росту функции, а увеличение другого фактора приводит к уменьшению функции у.

б) при значительной отрицательной корреляции между факторами увеличение одного фактора сопровождается уменьшением другого фактора и это делает факторы разнозначными, поэтому возможен любой знак влияния факторов на функцию у .

На практике выделяют некоторые наиболее характерные признаки мультиколлинеарности.: 1. Небольшое изменение исходных данных (например, добавление новых наблюдений) приводит к существенному изменению оценок коэффициентов модели. 2. Оценки имеют большие стандартные ошибки, малую значимость, в то время как модель в целом является значимой (высокое значение коэффициента детерминации R 2 и соответствующей F-статистики). 3. Оценки коэффициентов имеют неправильные с точки зрения теории знаки или неоправданно большие значения.

Косвенными признаками мультиколлинеарности являются высокие стандартные ошибки оценок параметров модели, малые t-статистики (то есть незначимость коэффициентов), неправильные знаки оценок, при том, что модель в целом признается статистически значимой (большое значение F-статистики). О мультиколлинеарности также может свидетельствовать сильное изменение оценок параметров от добавления (или удаления) выборочных данных (если соблюдены требования достаточной однородности выборки).

Для обнаружения мультиколлинеарности факторов можно проанализировать непосредственно корреляционную матрицу факторов. Уже наличие больших по модулю (выше 0,7-0,8) значений коэффициентов парной корреляции свидетельствует о возможных проблемах с качеством получаемых оценок.

Однако, анализ парных коэффициентов корреляции недостаточен. Необходимо проанализировать коэффициенты детерминации регрессий факторов на остальные факторы (). Рекомендуется рассчитывать показатель. Слишком высокие значения последнего означают наличие мультиколлинеарности.

Таким образом, главные критерии обнаружения мультиколлинеарности заключаются в следующем: высокий R 2 при всех незначимых коэффициентах,высокие парные коэффициенты корреляции,высокие значения коэффициента VIF .

1.2. Основные способы устранения мультиколлинеарности в эконометрических моделях

Прежде чем указать основные методы устранения мультиколлинеарности, отметим, что в ряде случаев мультиколлинеарность не является серьёзной проблемой, предполагающей существенные усилия по ее выявлению и устранению. В основном всё зависит от целей исследования.

Если основная задача модели - прогноз будущих значений регрессанда, то при достаточно большом коэффициенте детерминации R2 (> 0,9) наличие мультиколлинеарности обычно не сказывается на прогнозных качествах модели. Хотя это утверждение будет обоснованным лишь в том случае, что и в будущем между коррелированными регрессорами будут сохраняться те же отношения, что и ранее. Если же целью исследования является определение степени влияния каждого из регрессоров на регрессанд, то наличие мультиколлинеарности, приводящее к увеличению стандартных ошибок, скорее всего, исказит истинные зависимости между регрессорами. В этой ситуации мультиколлинеарность является серьезной проблемой.

Отметим, что единого метода устранения мультиколлинеарности, годного в любом случае, не существует. Это связано с тем, что причины и последствия мультиколлинеарности неоднозначны и во многом зависят от результатов выборки .

На практике выделяют основные методы устранения мультиколлинеарности:

- Исключение регрессоров из модели простейшим методом устранения мультиколлинеарности является исключение из модели одной или ряда коррелированных регрессоров. Однако необходима определенная осмотрительность при применении данного метода. В этой ситуации возможны ошибки спецификации. Например, при исследовании спроса на некоторое благо в качестве объясняющих переменных можно использовать цену данного блага и цены заменителей данного блага, которые зачастую коррелируют друг с другом. Исключив из модели цены заменителей, мы, скорее всего, допустим ошибку спецификации. Вследствие этого можно получить смещенные оценки и сделать необоснованные выводы. Таким образом, в прикладных эконометрических моделях желательно не исключать регрессоры до тех пор, пока их коллинеарность не станет серьезной проблемой.

- Получение дополнительных данных или новой выборки поскольку мультиколлинеарность напрямую зависит от выборки, то, возможно, при другой выборке мультиколлинеарности вообще не будет либо она не будет столь серьезной. Иногда для уменьшения мультиколлинеарности достаточно увеличить объем выборки. Например, при использовании ежегодных данных можно перейти к поквартальным данным. Увеличение количества данных сокращает дисперсии коэффициентов регрессии и тем самым увеличивает их статистическую значимость. Однако получение новой выборки или расширение старой не всегда возможно или связано с серьезными издержками. Кроме того, такой подход может усилить автокорреляцию. Эти проблемы ограничивают возможность использования данного метода.

III. Изменение спецификации модели В ряде случаев проблема мультиколлинеарности может быть решена путем изменения спецификации модели: либо изменяется форма модели, либо добавляются новые регрессоры, не учтенные в первоначальной модели, но существенно влияющие на зависимую переменную. Если данный метод имеет основания, то его использование уменьшает сумму квадратов отклонений, тем самым, сокращая стандартную ошибку регрессии. Это приводит к уменьшению стандартных ошибок коэффициентов.

- Преобразование переменных в ряде случаев минимизировать либо вообще устранить проблему мультиколлинеарности можно только с помощью преобразования переменных. Исходные данные в каждом наблюдении делятся на значения одного из зависимых регрессоров в данном наблюдении. Применение метода главных компонент к факторам модели позволяет преобразовать исходные факторы и получить совокупность ортогональных (некоррелированных) факторов. При этом наличие мультиколлинеарности позволит ограничиться небольшим количеством главных компонент. Тем не менее, может возникнуть проблема содержательной интерпретации главных компонент .

Если по всем признакам имеется мультиколлинеарность, то среди эконометристов есть разные мнения на этот счет. При столкновении с проблемой мультиколлинеарности может возникнуть естественное желание отбросить «лишние» независимые переменные, которые, возможно, служат ее причиной. Однако следует помнить, что при этом могут возникнуть новые трудности. Во-первых, далеко не всегда ясно, какие переменные являются лишними в указанном смысле.

Мультиколлинеарность означает лишь приблизительную линейную зависимость между факторами, но это не всегда выделяет «лишние» переменные. Во-вторых, во многих ситуациях удаление каких-либо независимых переменных может значительно отразиться на содержательном смысле модели. Наконец, отбрасывание так называемых существенных переменных, т.е. независимых переменных, которые реально влияют на изучаемую зависимую переменную, приводит к смещению коэффициентов модели. На практике, обычно при обнаружении мультиколлинеарности убирают наименее значимый для анализа фактор, а затем повторяют расчеты.

Таким образом, на практике выделяют основные методы устранения мультиколлинеарности: изменение или увеличение выборки, исключение одной из переменной, преобразование мультиколлинеарных переменных (использовать нелинейные формы, использовать агрегаты (линейные комбинации нескольких переменных), использовать первые разности вместо самих переменных. Однако если мультиколлинеарность не устраняется, можно её игнорировать с учетом целесообразие исключения.

- Проектная часть

2.1. Информационно-методическое обеспечение эконометрического исследования

Информационное обеспечение эконометрического исследования включает следующие сведения:

Входные сведения:

- статистические данные по социально-экономическому показателю, определяемому как зависимая переменная (факторы - результата);

- статистические данные по социально-экономическим показателям, определяемым как объясняющие переменные (факторы - признака);

Промежуточные сведения:

- модель уравнения регрессии, оцененное уравнение регрессии, показатели качества и заключение о качестве уравнения регрессии, заключение о наличии (отсутствии) проблемы мультиколлинеарности, рекомендации по применению модели;

Результативные сведения:

- оцененное уравнение регрессии, заключение о качестве уравнения регрессии, заключение о наличии (отсутствии) проблемы мультиколлинеарности, рекомендации по применению модели.

Методика эконометрического исследования заключается в следующем: спецификация; параметризация, верификация, дополнительное исследование, прогнозирование.

1.Спецификация модели уравнения регрессии включает в себя графический анализ корреляционной зависимости зависимой переменной от каждой объясняющей переменной. По результатам графического анализа делается заключение о модели уравнения регрессии линейного или нелинейного видов. Для проведения графического анализа чаще всего рекомендуют использовать инструмент «Точечная диаграмма» MsExcel. В результате этого этапа определяется модель уравнения регрессии, причем в случае нелинейного вида также определяются способы ее линеаризации.

2.Параметризация уравнения регрессии включает в себя оценку параметров регрессии и их социально-экономическую интерпретацию. Для параметризации используют инструмент «Регрессия» в составе надстроек «Анализ данных» MsExcel. По результатам автоматизированного регрессионного анализа (столбец «Коэффициенты») определяются параметры регрессии, также дается их интерпретация согласно типовому правилу:

Bj представляет собой величину, на которую в среднем изменяется значение переменной Y при увеличении независимой переменной Xj на единицу при прочих равных условиях.

Свободный член уравнения регрессии равен предсказанному значению зависимой переменной Y в случае, когда все независимые переменные равны нулю.

3.Верификация уравнения регрессии проводится на основе результатов автоматизированного регрессионного анализа (этап 2) по следующим показателям: «R-квадрат», «Значимость F», «P-значение» (по каждому параметру регрессии), а также по графикам подбора и остатков.

Определяется значимость коэффициентов и оценивается качество модели. Для этого рассматривается “Значимость F”, “P-Значение” и “R-квадрат”. Если “P-значение” меньше статического уравнения значимости, то это говорит о значимости коэффициента. Если “R-квадрат” больше 0.6, то это означает, модель регрессии хорошо описывает поведение зависимой переменной Y от факторов переменных.

Если “Значимость F” меньше статического уравнения значимости, то коэффициент детерминации(R-квадрат) признается условно статистически значимым.

График остатков позволяет оценить вариации ошибок. Если нет особых различий между ошибками, соответствующими разным значениям Xi, то есть вариации ошибок при разных значениях Хi приблизительно одинаковы и можно предположить, отсутствие проблем. График подбора позволяет сформировать суждения о базисном, предсказанных и факторных значений.

В заключение формируется суждение о качестве уравнения регрессии.

- Дополнительное исследование.

4.1.Обнаружение первого признака мультиколлинеарности. На основе полученных в п.2-3 результатов регрессионного анализа проверяется ситуации, при которой коэффициент детерминации имеет высокое значение (R 2 >0.7) и статически значим (Значимость F <0,05), и хотя бы один из коэффициентов регрессии не может быть признан статистически значим (P-значение >0,05).При обнаружении, такой ситуации, делается вывод о предположении мультиколлинеарности.

4.2.Обнаружение второго признака мультиколлинеарности. На основе расчетов коэффициентов корреляции между факторными переменными определяется существенная взаимосвязь отдельных факторов. Для расчетов в MS Excel, целесообразно использовать инструмент “Анализ данных / Корреляция”. По значениям коэффициента кореляции делаются выводы: чем ближе (r) к крайним точкам (±1), тем больше степень линейной связи, если коэффициент корреляции меньше 0,5, то считается, что связь слабая. Наличие мультиколлинеарности предполагается в следующем случае, если хотя бы между двумя переменными имеется существенный коэффициент корреляции (т.е. больше 0,7 по модулю).

4.3.Обнаружение третьего признака мультиколлинеарности. На основе оценки вспомогательных регрессий между факторными переменными, причём между переменными где имеется существенный коэффициент корреляции (п.4.2), делается вывод о наличии мультиколлинеарности, если хотя бы в одной вспомогательной регрессии является существенным и значимым. Метод дополнительных регрессий коэффициента детерминации заключается в следующем: 1) cтроятся уравнения регрессии, которые связывают каждый из регрессоров со всеми оставшимися; 2) вычисляются коэффициенты детерминации R 2 для каждого уравнения регрессии; 3) если уравнение и коэффициент детерминации признаётся статистически значимым, значит данный регрессор приводит к мультиколлинеарности.

4.4.Обобщение суждений.

На основе п.4.1-4.3 формируется суждение о наличии / отсутствии мультиколлинеарности и регрессоров, приводящих к мультиколлинеарности.

Далее формируется направления использования модели (в случае игнорирования или отсутствие проблемы мультиколлинеарности) или рекомендации по устранению мультиколлинеарности (на практике, исключение переменной).

При исключении переменной целесообразно использовать правило:

Определяется коэффициент детерминации для первоначально построенного по n наблюдениям уравнения регрессии (R 2 1);

Исключением из рассмотрения (k) последних переменных формируется уравнение для оставшихся факторов по первоначальным n наблюдениям и определяется для него коэффициент детерминации (R 2 2);

Рассчитывается F-статистика: где (R 1 2 -R 2 2)- потеря уравнения в качества результате отбрасывания к переменных, (K) - число дополнительно появившихся степеней свободы, (1- R 1 2)/(n-m-l) - необъясненная дисперсия первоначального уравнения;

Определяется критическое значение F a ,k ,n- m -1 по таблицам критических точек распределения Фишера при заданном уровне значимости а и степенях свободы v 1 =k, v 2 =n-m-l;

Формируется суждения о целесообразности исключении по правилу: исключение (одновременное) из уравнения k переменных считается нецелесообразным при F > F a , k , n- m - 1 , в противном случае - такое исключение допустимо.

При устранении переменной, получаемая модель анализируется согласно, п.п.3-4; и сравнивается с исходной моделью, в результате выбирается «лучшая». На практике, так как мультиколлинеарность не влияет на прогнозные качества модели, эта проблема может игнорироваться.

5.Прогнозирование проводится по исходной/«лучшей» модели, выбранной в пункте 4.4, по схеме ретроспективного прогноза, при котором для прогноза используется последняя 1/3 наблюдений.

5.1. Точечный прогноз. Фактические значения факторных переменных в прогнозном периоде считаются предсказанными, прогнозные значения результативной переменной определяются как предсказанные по исходной/«лучшей» модели на основе факторных переменных в прогнозном периоде. С помощью инструмента Microsoft Excel «График» строится график фактических и предсказанных згачений результативной переменной по наблюдениям и делается вывод о близости фактических значений к прогнозным.

5.2. Интервальный прогноз предполагает расчет стандартных ошибок предсказания (с помощью фиктивных переменных Салкевера) и верхних и нижних границ прогнозных значений.

С помощью инструмента Microsoft Excel «Анализ данных/Регрессия» строится регрессия для совокупного набора данных выборки и прогнозного периода, но с добавлением фиктивных переменных D 1 , D 2 , ..., D p . При этом D i = 1 только для момента наблюдения (n + i), для всех других моментов D i =0. Тогда коэффициент при фиктивной переменной D i равен ошибке предсказания в момент (n + i), а стандартная ошибка коэффициента равна стандартной ошибке предсказания (S i). Так, проводится автоматизированный регрессионный анализ модели, где в качестве значений X используются совокупные (выборочные и прогнозные) значения факторных переменных и значения фиктивных переменных Салкевера, в качестве значений Y - совокупные (выборочные и прогнозные) значения результативной переменной.

Полученные стандартные ошибки коэффициентов при фиктивных переменных Салкевера равны стандартным ошибкам предсказания. Тогда границы интервального прогноза рассчитываются по следующим формулам: Ymin n + i =Yэмп n + i -S i *t кр, Ymax n + i =Yэмп n + i +S i *t кр, где t кр - критическое значение распределения Стьюдента, определяемое по формуле « =СТЬЮРАСПОБР(0,05; n-m-1)», m- количество объясняющих факторов в модели (Y * t), Yэмп n + i - прогнозные значения результативной переменной (п.5.1).

С помощью инструмента Microsoft Excel «График» строится график по фактическим и предсказанным значениям результативной переменной, верхним и нижним границам прогноза по наблюдениям. Делается вывод о вписываемости фактических значений результативной переменной в границы интервального прогноза.

5.3. Оценка устойчивости модели с помощью теста ЧОУ проводится следующим образом:

а) с помощью инструмента Microsoft Excel «Анализ данных/Регрессия» строится регрессия, где в качестве значений X принимаются совокупные (выборочные и прогнозные) значения факторных переменных, а в качестве значений Y - совокупные (выборочные и прогнозные) значения результативной переменной. По данной регрессии определяется сумма квадратов остатков S;

б) по регрессии п.5.2 с фиктивными переменными Салкевера определяется сумма квадратов остатков Sd;

в) рассчитывается и оценивается значение Fстатистики по формуле:

где p- количество прогнозных шагов. Если полученное значение больше критического значения F кр, определяемого по формуле «=FРАСПОБР(0,05; p; n-m-1)», тогда гипотеза о стабильности модели в прогнозном периоде отклоняется, в противном случае - принимается.

5.4.Обобщение суждений о прогнозных качествах модели на основе п.5.1-5.3, в результате формируется заключение о прогнозном качестве модели и рекомендации по применению модели для прогнозирования.

Так, разработанное информационно-методическое обеспечение соответствует основным задачам эконометрического исследования проблемы мультиколлинеарности в моделях множественной регрессии.

2.2. Пример эконометрического исследования

Исследование проводится на основе данных, отражающих реальные макроэкономические показатели РФ за период 2003-2011 г.г. (табл. 1), согласно методике п.2.1.

Таблица 1

|

Расходы дом. хозяйств (млрд.руб)[Y] |

Численность населения (млн. чел) |

Денежная масса (млрд.руб.) |

Уровень безработицы (%) |

|

1.Спецификация модели уравнения регрессии включает графический анализ корреляционной зависимости зависимой переменной Y (Расходы дом. хозяйств от объясняющей переменной X 1 (Численность населения) (рис. 1), корреляционной зависимости зависимой переменной Y (Расходы дом. хозяйств от объясняющей переменной X 2 (Денежная масса) (рис. 2), корреляционной зависимости зависимой переменной Y (Расходы дом. хозяйств от объясняющей переменной X 3 (Уровень безработицы) (рис. 3).

График корреляционной зависимости между Y и X 1 , представленный на рисунке 1, отражает существенную (R 2 =0,71) обратную линейную зависимость Y от X 1 .

График корреляционной зависимости между Y и X 2 , представленный на рисунке 2, отражает существенную (R 2 =0,98) прямую линейную зависимость Y от X 2 .

График корреляционной зависимости между Y и X 3 , представленный на рисунке 3, отражает несущественную (R 2 =0,15) обратную линейную зависимость Y от X 3 .

Рисунок 1

Рисунок 2

Рисунок 3

В результате можно специфицировать модель линейной множественной регрессии Y=b 0 +b 1 X 1 +b 2 X 2 + b 3 X 3 .

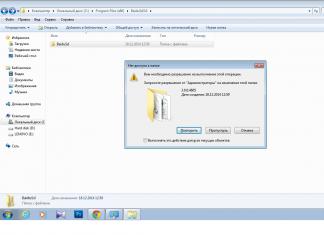

2.Параметризация уравнения регрессии проводится с использованием инструмента «Регрессия» в составе надстроек «Анализ данных» MsExcel (рис. 4).

Рисунок 4

Оцененное уравнение регрессии имеет вид:

233983,8- 1605,6Х 1 + 1,0Х 2 + 396,22X 3 .

При этом коэффициенты регрессии интерпретируются следующим образом: при увеличении численности населения на 1 млн. чел расходы дом. хозяйств уменьшаются на 1605,6 млрд. руб.; при увеличении денежной массы на 1 млрд.руб. расходы дом. хозяйств увеличатся на 1,0 млрд.руб.; при увеличении уровня безработицы на 1%, расходы дом. хозяйств будут увеличиваться на 396,2 млрд.руб. При нулевых значениях факторных переменных расходы дом. хозяйств составят 233983,8 млрд.руб, что, возможно, не имеет экономической интерпретации.

3.Верификация уравнения регрессии проводится на основе результатов автоматизированного регрессионного анализа (этап 2).

Так, «R-квадрат» равен 0,998, т.е. уравнение регрессии описывает поведение зависимой переменной на 99%, что говорит о высоком уровне описания уравнения. «Значимость F» равна 2,14774253442155E-07, что говорит о том, что «R-квадрат» значим. «Р-Значение» для b 0 равно 0,002, что говорит о том, что данный параметр значим. «Р-Значение» для b 1 равно 0,002, что говорит о том, что данный коэффициент значим. «Р-Значение» для b 2 равно 8,29103190343224E-07, что говорит о том, что данный коэффициент значим. «Р-Значение» для b 3 равно 0,084, что говорит о том, что данный коэффициент не значим.

На основе графиков остатков остатки е представляют собой случайные величины.

На основе графиков подбора делается заключение о близости фактических и предсказанных значений по модели.

Так, модель имеет хорошее качество, при этом b 3 не значим, поэтому можно предположить наличие мультиколлинеарности.

4.Дополнительное исследование.

4.1. Обнаружение первого признака мультиколлинеарности. По данным регрессионного анализа (рисунка 5) можно сказать, что имеется первый признак мультиколлинеарности, так как выявляется высокий и значимый R 2 , выявлено, что уравнение имеет высокий коэффициент детерминации, а также один из коэффициентов не значимый. Это позволяет предположить наличие мультиколлинеарности.

4.2.Обнаружение второго признака мультиколлинеарности.

На основе расчетов коэффициентов корреляции между факторными переменными определяется существенная взаимосвязь отдельных факторов. (табл.2). Наличие мультиколлинеарности предполагается в следующем случае, если хотя бы между двумя переменными имеется существенный коэффициент корреляции (т.е. больше 0,5 по модулю).

Таблица 2

|

[ X2] |

[ X3] |

|||

|

[ X2] |

||||

|

[ X3] |

В нашем случае существует коэффициент корреляции между Х 1 и Х 2 (-0,788), что говорит о сильной зависимости между переменными X 1, X 2 , так же существует коэффициент корреляции между Х 1 и Х 3 (0,54), что говорит о сильной зависимости между переменными X 1, X 3.

В результате можно предположить наличие мультиколлинеарности.

4.3.Обнаружение третьего признака мультиколлинеарности.

Так как в п.4.2 обнаружена сильная зависимость между переменными X 1 и X 2 , далее анализируется вспомогательная регрессия между этими переменными (рис. 5).

Рисунок 5

Так как «Значимость F» равна 0,01, что говорит о том, что «R-квадрат» и вспомогательная регрессия значимы, поэтому можно предположить, что регрессор X 2 приводит к мультиколлинеарности.

Так как в п.4.2 обнаружена выше среднего уровня зависимость между переменными X 1 и X 3 , далее анализируется вспомогательная регрессия между этими переменными (рис. 6).

Рисунок 6

Так как «Значимость F» равна 0,13, что говорит о том, что «R-квадрат» и вспомогательная регрессия не значимы, поэтому можно предположить, что регрессор X 3 не приводит к мультиколлинеарности.

Так, согласно третьему признаку, можно предположить наличие мультиколлинеарности.

4.4.Обобщение суждений.

По данным анализа п.4.1-4.3, обнаружены все три признака мультиколлинеарности, поэтому ее можно предположить с высокой вероятностью. При этом несмотря на предположение в п.4.3 относительно регрессора, приводящего к мультиколлинеарности, можно рекомендовать исключение X 3 из исходной модели, т.к. X 3 имеет наименьший коэффициент корреляции с Y и коэффициент при этом регрессоре является незначимым в исходном уравнении. Результаты регрессионного анализа после исключения X 3 представлены на рис. 7.

Рисунок 7

При этом рассчитаем F - статистику для проверки целесообразности исключения:

F факт = 4,62,

причем F табл = F 0,05;1;5 = 6,61, так как F факт < F табл, то исключение допустимо для переменной X 3 .

Оценка качества модели линейной множественной регрессии Y=b 0 +b 1 X 1 +b 2 X 2 . «R-квадрат» равен 0,996, т.е. уравнение регрессии описывает поведение зависимой переменной на 99%, что говорит о высоком уровне описания уравнения. «Значимость F» равна 3,02415218982089E-08, что говорит о том, что «R-квадрат» значим. «Р-Значение» для b 0 равно 0,004, что говорит о том, что данный параметр значим.«Р-Значение» для b 1 равно 0,005, что говорит о том, что данный коэффициент значим. «Р-Значение» для b 2 равно 3,87838361673427E-07, что говорит о том, что данный коэффициент значим. Оцененное уравнение регрессии имеет вид:

201511,7 -1359,6Х 1 + 1,01Х 2

При этом коэффициенты регрессии интерпретируются следующим образом: при уменьшении численности населения на 1 млн. чел расходы дом. хозяйств уменьшаются на 1359,6 млрд. руб.; при увеличении уровня денежной массы, расходы дом. хозяйств увеличатся на 1,0) (млрд.руб). При нулевых значениях факторных переменных расходы дом. хозяйств составят 201511,7 млрд.руб, что, возможно, имеется экономическая интерпретация.

Так, модель = 201511,7 -1359,6Х 1 + 1,01Х 2 имеет хорошее качество и рекомендуется для прогнозирования в качестве «лучшей» в сравнении с исходной моделью.

5.Прогнозирование.

5.1.Точечный прогноз. Фактические значения факторных переменных в прогнозном периоде считаются предсказанными, прогнозные значения результативной переменной определяются как предсказанные по «лучшей» модели (= 201511,7 -1359,6Х 1 + 1,01Х 2) на основе факторных переменных в прогнозном периоде. С помощью инструмента Microsoft Excel «График» строится график фактических и предсказанных згачений результативной переменной по наблюдениям и делается вывод о близости фактических значений к прогнозным.

Прогнозные значения факторных переменных представлены в табл.3.

Таблица 3

Прогнозные значения результативной переменной определяются как предсказанные по «лучшей» модели (= 201511,7 -1359,6Х 1 + 1,01Х 2) на основе факторных переменных в прогнозном периоде. Прогнозные значения представлены в табл.4, для сравнения добавляются фактические значения.

Таблица 4

|

[Y] эмпирическое |

||||

На рис.8 представлены фактические и прогнозные значения результативной переменной, а также нижние и верхние границы прогноза.

Рисунок 8

Согласно рис.8, прогноз сохраняет возрастающую тенденцию, а также все прогнозные значения близки к фактическим.

5.2. Интервальный прогноз.

С помощью инструмента Microsoft Excel «Анализ данных/Регрессия» строится регрессия для совокупного набора данных выборки и прогнозного периода, но с добавлением фиктивных переменных D 1 , D 2 , ..., D p . При этом D i = 1 только для момента наблюдения (n + i), для всех других моментов D i =0. Данные представлены в табл.5, результат регрессии на рис.9.

Таблица 5

|

[Y]сов |

||||||

Рисунок 9

Тогда стандартная ошибка коэффициента при фиктивной переменной равна стандартной ошибке предсказания (S i): для 2012 года составит 738,5; для 2013 года составит 897,1; для 2014 года составит 1139,4.

Границы интервального прогноза рассчитываются в табл.6.

Таблица 6

|

[Y] эмпирическое |

[Y]сов |

[S] пр |

||||

По данным табл. 6 с помощью инструмента Microsoft Excel «График» строится график по фактическим и предсказанным значениям результативной переменной, верхним и нижним границам прогноза по наблюдениям (рис.10).

Рисунок 10

Согласно графику, прогнозные значения вписываются в границы интервального прогноза, что говорит о хорошем качестве прогноза.

5.3. Оценка устойчивости модели с помощью теста ЧОУ проводится следующим образом:

а) с помощью инструмента Microsoft Excel «Анализ данных/Регрессия» строится регрессия (рис.11), где в качестве значений X принимаются совокупные (выборочные и прогнозные) значения факторных переменных, а в качестве значений Y - совокупные (выборочные и прогнозные) значения результативной переменной. По данной регрессии определяется сумма квадратов остатков S=2058232,333.

Рисунок 11

б) по регрессии п.3.2 с фиктивными переменными Салкевера (рис. 9) определяется сумма квадратов остатков Sd=1270272,697.

в) рассчитывается и оценивается значение Fстатистики:

при этом F кр = F 0,05;3;5 = 5,40, тогда полученное значение меньше критического значения F кр и гипотеза о стабильности модели в прогнозном периоде принимается.

5.4.Обобщение суждений о прогнозных качествах модели на основе п.5.1-5.3, в результате формируется заключение о высоком прогнозном качестве модели (= 201511,7 -1359,6Х 1 + 1,01Х 2) и даются рекомендации по применению модели для прогнозирования.

Методика п.2.1 успешно апробирована, позволяет выявить основные признаки мультиколлинеарности и может быть рекомендована для подобных исследований.

Заключение

Мультиколлинеарность — в эконометрике (регрессионный анализ) — наличие линейной зависимости между объясняющими переменными (факторами) регрессионной модели. При этом различают полную коллинеарность, которая означает наличие функциональной (тождественной) линейной зависимости и частичную или просто мультиколлинеарность — наличие сильной корреляции между факторами.

Основные последствия мультиколлинеарности: большие дисперсии оценок, уменьшение t-статистик коэффициентов, оценки коэффициентов по МНК становятся неустойчивыми, затрудненное определения вклада переменных, получение неверного знака у коэффициента.

Главные критерии обнаружения мультиколлинеарности заключаются в следующем: высокий R 2 при незначимых коэффициентах; Высокие парные коэффициенты корреляции; высокие значения коэффициента VIF.

Основные методы устранения мультиколлинеарности: исключение переменной(ых) из модели; получение дополнительных данных или новой выборки; изменение спецификации модели; использование предварительной информации о некоторых параметрах.

Разработанное информационно-методическое обеспечение соответствует основным задачам эконометрического исследования проблемы мультиколлинеарности в моделях множественной регрессии и может быть рекомендовано для подобных исследований.

Список использованных источников

- Астахов, С.Н. Эконометрика [Текст]: Учебно-методический комплекс. Казань, 2008. - 107с.

- Бардасов, С. А. ЭКОНОМЕТРИКА [Текст]: учебное пособие. 2-е изд., пере- раб. и доп. Тюмень: Издательство Тюменского государственного университета, 2010. 264 с.

- Бородкина, Л.И. Курс лекций [Электронный ресурс]. Режим доступа - http://www.iskunstvo.info/materials/history/2/inf/correl.htm

- Воскобойников, Ю.Е. ЭКОНОМЕТРИКА в EXCEL Часть 1 [Текст]: учебное пособие, Новосибирск 2005,156 с.

- Елисеева, И.И. Практикум по эконометрике: учеб. пособие для экон. вузов / Елисеева, И.И., Курышева, С.В., Гордеенко, Н.М. , [и др.] ; под ред. И.И. Елисеевой - М.: Финансы и статистика, 2001. - 191 с. - (14126-1).

- Мультиколлинеарность [Электронный ресурс]. Режим доступа - https://ru.wikipedia.org/wiki/Мультиколлинеарность.

- Новиков, А.И. Эконометрика [Текст]: учеб. пособие по напр. "Финансы и кредит", "Экономика" - М.: Дашков и К, 2013. - 223 с.- (93895-1).

- Проблема мультиколлинеарности [Электронный ресурс]. Режим доступа - http://crow.academy.ru/econometrics/lectures_/lect_09_/lect_09_4.pdf .

- Черняк, В. Прикладная эконометрика. Лекция №9 [Электронный ресурс]. Режим доступа http://www.slideshare.net/vtcherniak/lect-09.

- ru - энциклопедический сайт [Электронный ресурс]. Режим доступа - http://kodcupon.ru/ra17syplinoe97/Мультиколлинеарность.

Скачать: У вас нет доступа к скачиванию файлов с нашего сервера.

Федеральное агентство по образованию и науке РФ

Костромской государственный технологический университет.

Кафедра высшей математики

по эконометрике на тему:

Мультиколлинеарность

Выполнила

студент 1 курса

заочного факультета

сп-ть «Бухгалтерский учёт,

анализ и аудит».

Проверила

Катержина С.Ф.

Кострома 2008 г

Мультиколлинеарность

Под мультиколлинеарностью понимается высокая взаимная коррелированность объясняющих переменных. Мультиколлинеарность может проявляться в функциональной (явной) и стохастической (скрытой) формах.

При функциональной форме мультиколлинеарности по крайней мере одна из парных связей между объясняющими переменными является линейной функциональной зависимостью. В этом случае матрица X`X особенная, так как содержит линейно зависимые векторы-столбцы, и её определитель равен нулю, т.е. нарушается предпосылка регрессионного анализа, это приводит к невозможности решения соответствующей системы нормальных уравнений и получения оценок параметров регрессионной модели.

Однако в экономических исследованиях мультиколлинеарность чаще проявляется в стохастической форме, когда между хотя бы двумя объясняющими переменными существует тесная корреляционная связь. Матрица X`X в этом случае является неособенной, но её определитель очень мал.

В то же время вектор оценок b и его ковариционная матрица ∑ b пропорциональны обратной матрице (X`X) -1 , а значит, их элементы обратно пропорциональны величине определителя |X`X|. В результате получаются значительные средние квадратические отклонения (стандартные ошибки) коэффициентов регрессии b 0 , b 1 ,…,b p и оценка их значимости по t-критерию не имеет смысла, хотя в целом регрессионная модель может оказаться значимой по F-критерию.

Оценки становятся очень чувствительными к незначительному изменению результатов наблюдений и объёма выборки. Уравнения регрессии в этом случае, как правило, не имеют реального смысла, так как некоторые из его коэффициентов могут иметь неправильные с точки зрения экономической теории знаки и неоправданно большие значения.

Точных количественных критериев для определения наличия или отсутствия мультиколлинеарности не существует. Тем не менее, имеются некоторые эвристические подходы по её выявлению.

Один из таких подходов заключается в анализе корреляционной матрицы между объясняющими переменными X 1 ,X 2 ,…,X p и выявлении пар переменных, имеющих высокие переменные корреляции (обычно больше 0,8). Если такие переменные существуют, говорят о мультиколлинеарности между ними. Полезно также находить множественные коэффициенты детерминации между одной из объясняющих переменных и некоторой группой из них. Наличие высокого множественного коэффициента детерминации (обычно больше 0,6) свидетельствует о мультиколлинеарности.

Другой подход состоит в исследовании матрицы X`X. Если определитель матрицы X`X либо её минимальное собственное значение λ min близки к нулю (например одного порядка с накапливающимися ошибками вычислений), то это говорит о наличии мультиколлинеарности. о том же может свидетельствовать и значительное отклонение максимального собственного значения λ max матрицы X`X от её минимального собственного значения λ min .

Для устранения или уменьшения мультиколлинеарности используется ряд методов. Самый простой из них (но далеко не всегда возможный) состоит в том, что из двух объясняющих переменных, имеющих высокий коэффициент корреляции (больше 0,8), одну переменную исключают из рассмотрения. При этом, какую переменную оставить, а какую удалить из анализа, решают в первую очередь на основании экономических соображений. Если с экономической точки зрения ни одной из переменных нельзя отдать предпочтение, то оставляют ту из двух переменных, которая имеет больший коэффициент корреляции с зависимой переменной.

Другой метод устранения или уменьшения мультиколлинеарности заключается в переходе от несмещённых оценок, определённых по методу наименьших квадратов, к смещённым оценкам, обладающим, однако, меньшим рассеянием относительно оцениваемого параметра, т.е. меньшим математическим ожиданием квадрата отклонения оценки b j от параметра β j или M (b j - β j) 2 .

Оценки, определяемые вектором, обладают в соответствии с теоремой Гаусса-Маркова минимальными дисперсиями в классе всех линейных несмещённых оценок, но при наличии мультиколлинеарности эти дисперсии могут оказаться слишком большими, и обращение к соответствующим смещённым оценкам может повысить точность оценивания параметров регрессии. На рисунке показан случай, когда смещённая оценка β j ^ , выборочное распределение которой задаётся плотностью φ (β j ^).

Действительно, пусть максимально допустимый по величине доверительный интервал для оцениваемого параметра β j есть (β j -Δ, β j +Δ). Тогда доверительная вероятность, или надёжность оценки, определяемая площадью под кривой распределения на интервале (β j -Δ, β j +Δ), как нетрудно видеть из рисунка, будет в данном случае больше для оценки β j по сравнению с b j (на рисунке эти площади заштрихованы). Соответственно средний квадрат отклонения оценки от оцениваемого параметра будет меньше для смещённой оценки, т.е.:

M (β j ^ - β j) 2 < M (b j - β j) 2

При использовании «ридж-регрессии» (или «гребневой регрессии») вместо несмещённых оценок рассматривают смещённые оценки, задаваемые вектором

β τ ^ =(X`X+τ E p +1) -1 X`Y,

где τ – некоторое положительное число, называемое «гребнем» или «хребтом»,

E p +1 – единичная матрица (р+1) –го порядка.

Добавление τ к диагональным элементам матрицы X`X делает оценки параметров модели смещёнными, но при этом увеличивается определитель матрицы системы нормальных уравнений – вместо (X`X) от будет равен

|X`X+τ E p +1 |

Таким образом, становится возможным исключение мультиколлинеарности в случае, когда определитель |X`X| близок к нулю.

Для устранения мультиколлинеарности может быть использован переход от исходных объясняющих переменных X 1 ,X 2 ,…,X n , связанных между собой достаточно тесной корреляционной зависимостью, к новым переменным, представляющим линейные комбинации исходных. При этом новые переменные должны быть слабо коррелированными либо вообще некоррелированными. В качестве таких переменных берут, например, так называемые главные компоненты вектора исходных объясняющих переменных, изучаемые в компонентном анализе, и рассматривают регрессию на главных компонентах, в которой последние выступают в качестве обобщённых объясняющих переменных, подлежащих в дальнейшем содержательной (экономической) интерпритации.

Ортогональность главных компонент предотвращает проявление эффекта мультиколлинеарности. Кроме того, применяемый метод позволяет ограничиться малым числом главных компонент при сранительно большом количестве исходных объясняющих переменных.

Мультиколлинеарность - это понятие, которое используется для описания проблемы, когда нестрогая линейная зависимость между объясняющими переменными приводит к получению ненадежных оценок регрессии. Разумеется, такая зависимость совсем необязательно дает неудовлетворительные оценки. Если все другие условия благоприятствуют, т. е. если число наблюдений и выборочные дисперсии объясняющих переменных велики, а дисперсия случайного члена -мала, то в итоге можно получить вполне хорошие оценки.

Итак, мультиколлинеарность должна вызываться сочетанием нестрогой зависимости и одного (или более) неблагоприятного условия, и это - вопрос

степени выраженности явления, а не его вида. Оценка любой регрессии будет страдать от нее в определенной степени, если только все независимые переменные не окажутся абсолютно некоррелированными. Рассмотрение данной проблемы начинается только тогда, когда это серьезно влияет на результаты оценки регрессии.

Эта проблема является обычной для регрессий временных рядов, т. е. когда данные состоят из ряда наблюдений в течение какого-то периода времени. Если две или более независимые переменные имеют ярко выраженный временной тренд, то они будут тесно коррелированы, и это может привести к мультиколлинеарности.

Что можно предпринять в этом случае?

Различные методы, которые могут быть использованы для смягчения мультиколлинеарности, делятся на две категории: к первой категории относятся попытки повысить степень выполнения четырех условий, обеспечивающих надежность оценок регрессии; ко второй категории относится использование внешней информации. Если сначала использовать возможные непосредственно получаемые данные, то, очевидно, было бы полезным увеличить число наблюдений.

Если вы применяете данные временных рядов, то это можно сделать путем сокращения продолжительности каждого периода времени. Например, при оценивании уравнений функции спроса в упражнениях 5.3 и 5.6 можно перейти с использования ежегодных данных на поквартальные данные.

После этого вместо 25 наблюдений их станет 100. Это настолько очевидно и так просто сделать, что большинство исследователей, использующих временные ряды, почти автоматически применяют поквартальные данные, если они имеются, вместо ежегодных данных, даже если проблема мультиколлинеарности не стоит, просто для сведения к минимуму теоретических дисперсий коэффициентов регрессии. В таком подходе существуют, однако, и потенциальные проблемы. Можно привнести или усилить автокорреляцию, но она может быть нейтрализована. Кроме того, можно привнести (или усилить) смещение, вызванное ошибками измерения, если поквартальные данные измерены с меньшей точностью, чем соответствующие ежегодные данные. Эту проблему не так просто решить, но она может оказаться несущественной.